- 产品名称:【长期主义】第119期科技说:特斯拉AI日全纪录研发AI训练芯片造超级计算机全面助力无人驾驶

时间: 2023-12-01 19:20:30 | 作者: 收银纸

- 详细介绍

原标题:【长期主义】第119期科技说:特斯拉AI日全纪录,研发AI训练芯片,造超级计算机,全面助力无人驾驶

“长期主义”栏目每周六更新,分为成长说(洛克菲勒)、社会说(比尔·盖茨)、投资说(巴菲特、芒格、Baillie Gifford、彼得·蒂尔、马克·安德森、凯瑟琳·伍德)、管理说(任正非、稻盛和夫)、科技说(马斯克、贝索斯、拉里·佩奇/谢尔盖·布林、扎克伯格、黄仁勋、Vitalik Buterin、Brian Armstrong、Jack Dorsey、孙正义、马化腾、张小龙、张一鸣、王兴)、汽车说(李想、何小鹏、李斌、王传福、魏建军、李书福)等系列。

每个系列聚焦各领域全球顶尖高手、产业领军人物,搜集整理他们的致股东信、公开演讲/交流、媒体采访等一手信息,一起学习经典,汲取思想养分,做时间的朋友,做长期主义者。

美国太平洋时间2021年8月19日下午17点(北京时间2021年8月20日上午8点),特斯拉在美国加州帕罗奥图总部召开AI日(AI Day),展示在AI领域多项进展。这是特斯拉2019年无人驾驶日(Autonomy Day)、2020年电池日(Battery Day)后,第三场技术发布会。

本期“长期主义”,我们系统学习特斯拉AI日3小时视频,查找国外相关文献,参考车东西、42号车库、汽车之心、电动星球News、华尔街见闻等国内报道,经过整理、精校,形成特斯拉AI日全纪录,分享给大家,enjoy!

特斯拉AI日发布会持续3小时,聚焦特斯拉底层AI技术与未来产品展望,集中展示纯视觉全无人驾驶系统FSD、神经网络训练超级计算机Dojo、首款人形机器人Tesla Bot等“黑科技”,是一场世界前沿的科技盛宴。

特斯拉CEO马斯克表示,这场活动唯一目的是招聘人才,吸引AI与机器人领域专家到特斯拉工作。会后第二天,马斯克转发了特斯拉官方的招聘链接。

这支AI战队对外集中展示特斯拉在Autopilot感知、规划控制、模拟、训练、自研芯片、超级计算机平台等领域最新成果,有三大核心主线,分别是自动驾驶FSD算法与神经网络训练进展、神经网络训练超级计算机Dojo与特斯拉自研AI训练芯片D1、人形机器人Tesla Bot。

特斯拉继2019年自动驾驶日、2020年电池日后,再次展示在汽车公司、自动驾驶软件公司、电池及能源公司外,特斯拉还是全球顶级AI公司,甚至是全球最大机器人公司。特斯拉成为全世界市值第一车企后,向外界展示距离自己的边界还很远。

特斯拉2021年预计汽车交付量将同比增长超过50%,2020年全年销售49.95万辆,居全球智能电动汽车销量第一。特斯拉2013年开始研发无人驾驶,在神经网络训练超级计算机Dojo与自研AI训练芯片D1加持下,未来将实现FSD全无人驾驶。

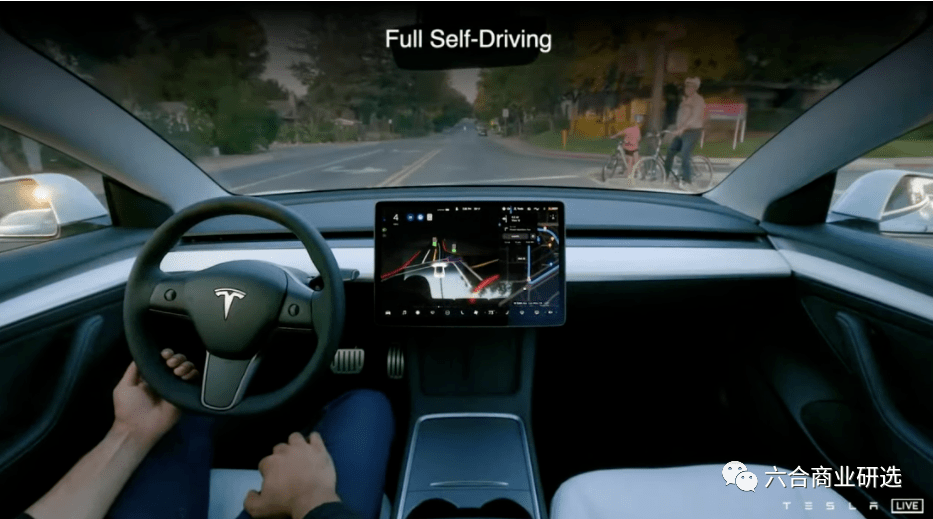

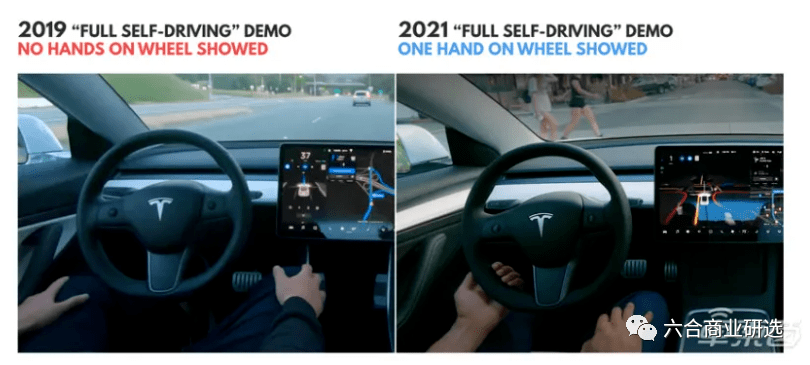

发布会开始后,特斯拉首先展示一段最新版FSD演示视频,特斯拉汽车非常熟练完成转向、避让行人、路口停车、识别红绿灯、没有车道线的乡村道路上行驶等动作。

相比2019年特斯拉FSD演示视频中驾驶员完全脱手驾驶,2021年演示视频中驾驶员用一只手扶着方向盘。前不久,美国国家公路交通安全管理局NHTSA对特斯拉Autopilot系统展开正式缺陷调查,调查内容与路边应急车辆相撞有关。特斯拉FSD演示视频的变化,强调自动驾驶能力目前仍在L2级,并非想象中的完全自动驾驶,使用中驾驶员一定要做好随时接管准备。

马斯克上台,做简单的开场白。马斯克表示,今天想给大家展示特斯拉不只是电动车公司,也是AI技术应用领域顶尖公司,在硬件、AI训练等方面,都有开展项目。今天你们可以看到特斯拉使用AI技术,在无人驾驶领域取得进展,当然AI应用领域还有更多。

谈到众人关注的自动驾驶安全问题时,马斯克表示,人的反应没有计算机快,人容易出错,计算机不易犯错,可将人看成是经过成熟培养的神经网络,这样就没什么问题。

谈到外界高度关注的Autopilot产品与技术进展时,马斯克表示,人才至关重要,就像一支球队,拥有最佳球员的球队通常会获胜,球员们采取的策略与合作形式会让胜率翻番。马斯克希望正在攻克AI领域难题的团队,积极加入特斯拉。

自动驾驶技术最重要的包含感知、规划控制、决策、执行等环节,感知环节大致上可以分为Waymo为代表的激光雷达主导,与特斯拉为代表的视觉主导两类技术路线。前者使用激光雷达、毫米波雷达、超声波传感器、摄像头等,成本高,远距离、全方位探测能力强,分辨率比较高,但对周围环境的颜色与纹理信息等识别能力弱;后者主要用车载摄像头,成本适中,但探测角度小,远距离探测能力不够,受环境、光照影响大。

特斯拉AI总监Andrej Karpathy上台,深度解读纯视觉感知实现无人驾驶技术。为实现无人驾驶,特斯拉基本逻辑是,建立类似人类的纯视觉感知技术,建立车载FSD芯片与云端超级计算机组成的计算平台,打造像人脑那样基于视觉的计算机神经网络系统,用大量数据训练AI算法,使汽车越来越擅长驾驶。

感知能力是实现无人驾驶首要前提,与别的公司大多研究多传感器无人驾驶技术不同,特斯拉坚持纯视觉感知路线,致力让汽车能像人类一样通过视觉观察路况,实现无人驾驶。

特斯拉坚持不用激光雷达,与马斯克奉行“第一性原理”有关,既然人类开车凭借眼观六路、耳听八方就能完成,对无人驾驶系统来说,一定也能按同样方式做到,一旦做到,成本将比激光雷达方案更低。

特斯拉纯视觉方案基本构建原则,是把自动驾驶系统看作生物,摄像头是眼睛,图像处理是神经,AI是大脑。

2021年5月,特斯拉在美国销售的Model 3/Y车型取消毫米波雷达,完全实现纯视觉解决方案。2021年7月,特斯拉面向早鸟用户推送FSD Beta V9。马斯克表示,FSD Beta V9后再经过2~3个版本迭代,FSD Beta将进入全美大规模推送。据新闻媒体报道,目前FSD Beta V10已接近开发完成,采用完全重新训练过的神经网络,预计4周内开启公测。

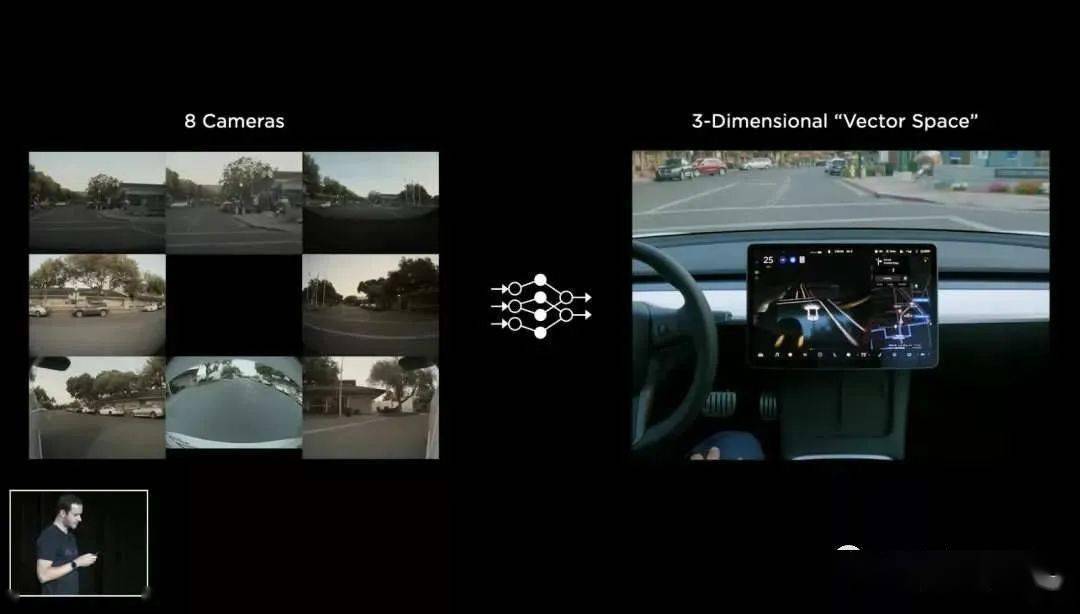

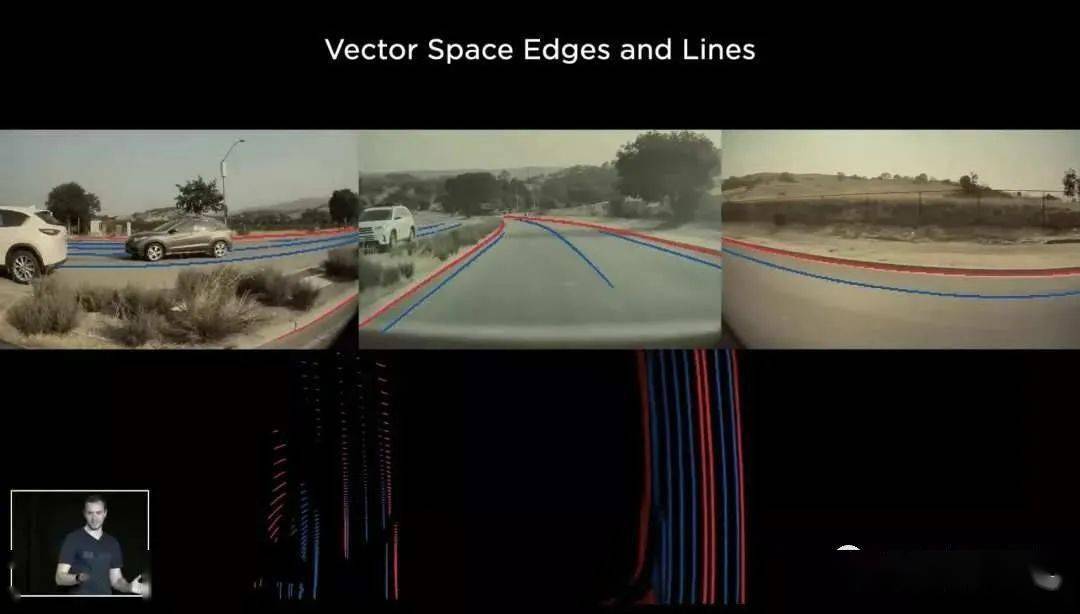

通过视觉方式实现无人驾驶,首先需给车辆安上眼睛,在特斯拉现售车型上,这部分由8个ADAS摄像头组成。它们均采用1,280*960分辨率12bit HDR图像,以36帧/秒的速率采集数据,在车身周围获取360°无死角视野,形成三维矢量空间,实现良好感知效果。

特斯拉汽车通过自身传感器与摄像头,绘制当前车辆周边路况信息,上传到特斯拉地图信息数据库,相当于道路上行驶的特斯拉汽车,都是特斯拉的道路测绘车。

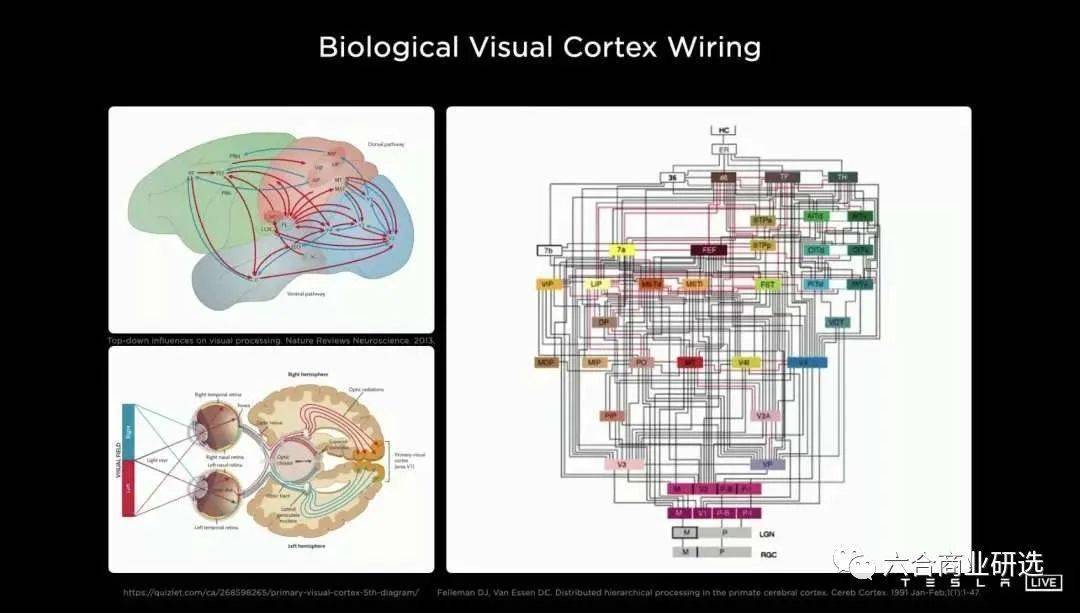

特斯拉设计无人驾驶AI视觉组件时,类比人脑识别图像,从头设计神经网络,按照生物视觉方法建模。例如,在为汽车设计“视觉皮层”时,特斯拉根据人眼如何感知生物视觉进行建模;采用多线并举模式,包括相机校准、缓存、队列等,简化所有任务;整套系统还需有视网膜、多目视觉的视交叉、视叶神经束等系列复杂神经网络,这些环节通过软件与算法实现。

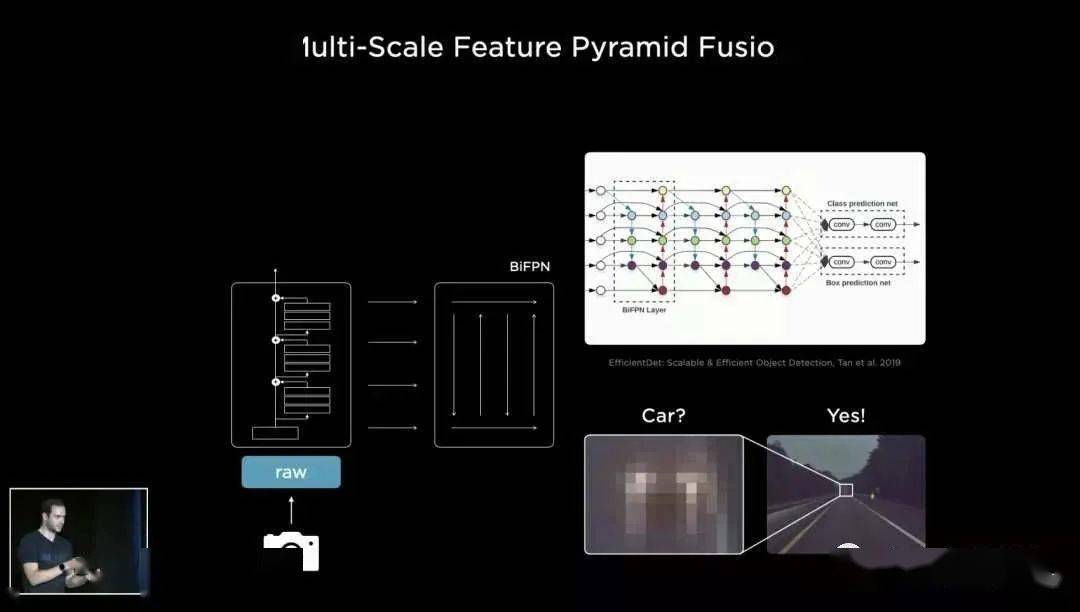

在识别视觉特征环节,大脑通过视网膜读取信息,电脑通过计算、对比像素排列进行识别。特斯拉在这个环节的软件特征提取方面,做不一样的区域的分工与相互配合,在特征识别上可做到结合环境情况,推测那些不够明显的特征,如下图中很模糊的车辆也能被识别。

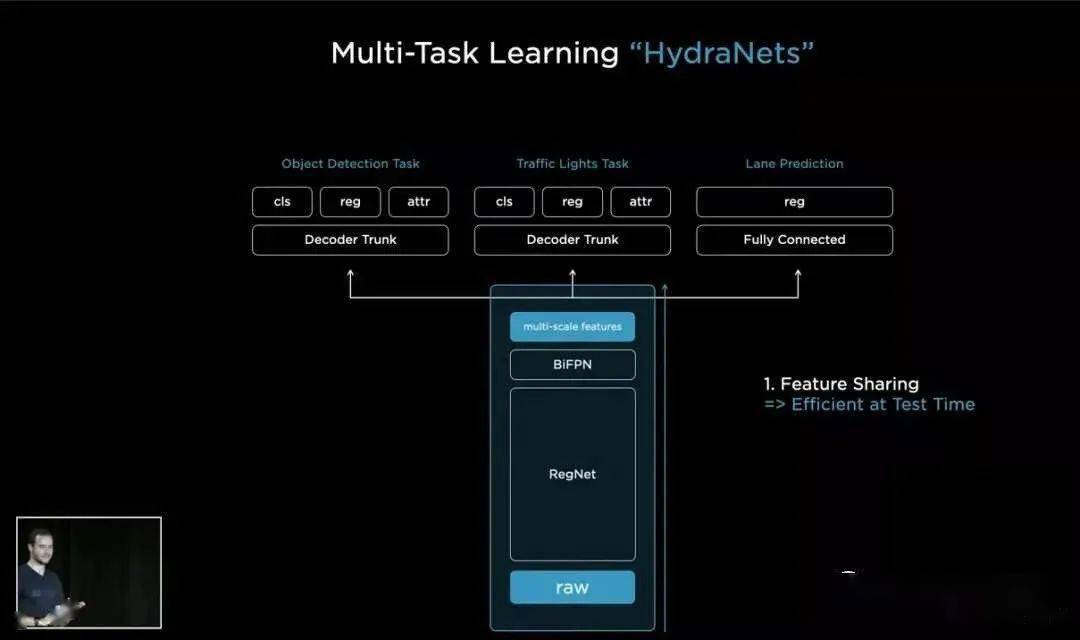

利用深度学习进行感知识别,属于多任务模型,涉及摄像头探测、跨摄像头融合等环节。针对不一样特征,特斯拉建立很多特征识别指令,这些指令可对同一素材进行多任务处理式的特征识别,这套识别网络称作HydraNet。

特斯拉视觉识别网络HydraNet,具有高效测试、可单独微调每个识别任务、能进行特征缓存与加速微调这三个特点,除了识别车辆,还能识别人、红绿灯等多种物体。

当前不少车企采用高精地图配合传感器,实现感知融合,但这样的形式不能让车辆正确无人驾驶,因此特斯拉开发环境建模追踪器Occupancy Tracker。特斯拉视觉识别网络HydraNet完成不一样特征识别后,利用环境建模追踪器Occupancy Tracker,实现带时间轴的跨画面图像拼接,构成车身周围环境模型。

这时特斯拉遇到两个问题,一个是环境建模工作量大,通过代码实现步骤复杂,另一个是建模精度不够高。特斯拉改变策略,原先做法是,先对每个摄像头分画面预测,再进行拼接与信息融合;现在思路是,先把8个摄像头素材拼接好,拟合成实时立体空间,再进行各种预测。这样的一个过程看似简单、做起来难,特斯拉在解决其中很多关键难题后,最后做出来的多摄像头视觉感知,精度显著提升。

尽管如此,通过多摄像头视觉感知没有办法解决的问题,还有物体特征被遮挡时的预测、对已通过道路标识的持续记忆等。

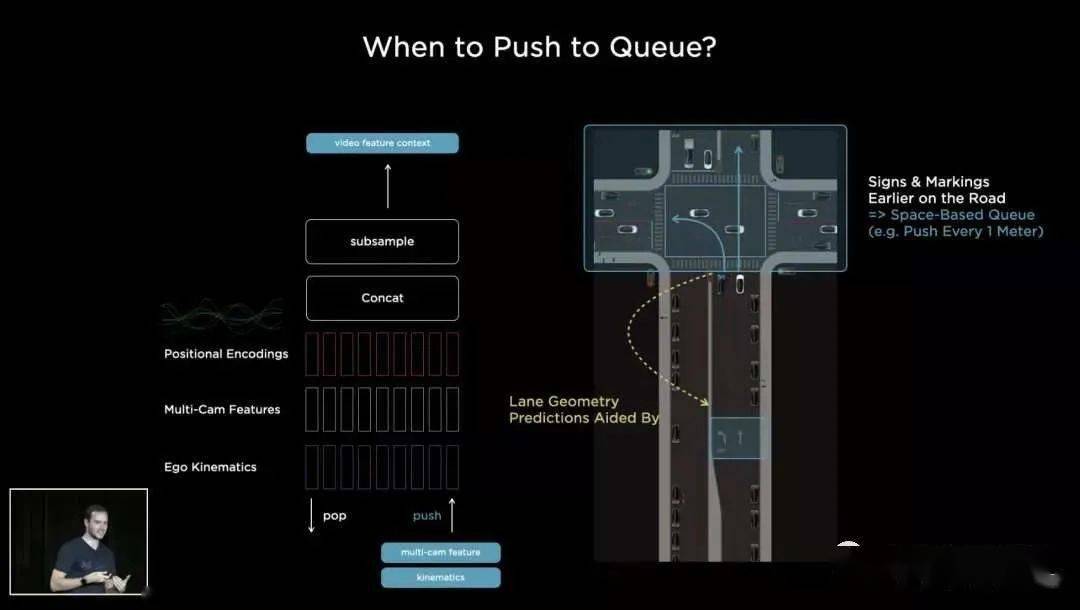

特斯拉在预测模型中,加入对特征随时间移动的预测,及对道路标识的距离记忆。有这些措施后,在视野被短暂遮挡情况下,系统可根据遮挡前物体轨迹,预测遮挡后物体轨迹,记下已行驶过路段的各种路标。特斯拉采用Transformer算法用于预测距离,实测发现,在一段两侧都停放车辆的城市道路上,多摄像头感知准确性与稳定性很强。

在这之后,FSD系统还加入空间递归神经网络Spatial RNN,在车辆视野范围内有选择的预测、记录环境中某类特征,还可同时记录多种特征。例如,有车辆遮挡视野时,FSD系统不会记录道路环境,等遮挡的车辆离开后再记录,同一条路多次通过后,这些记录的环境特征可构成特征地图。

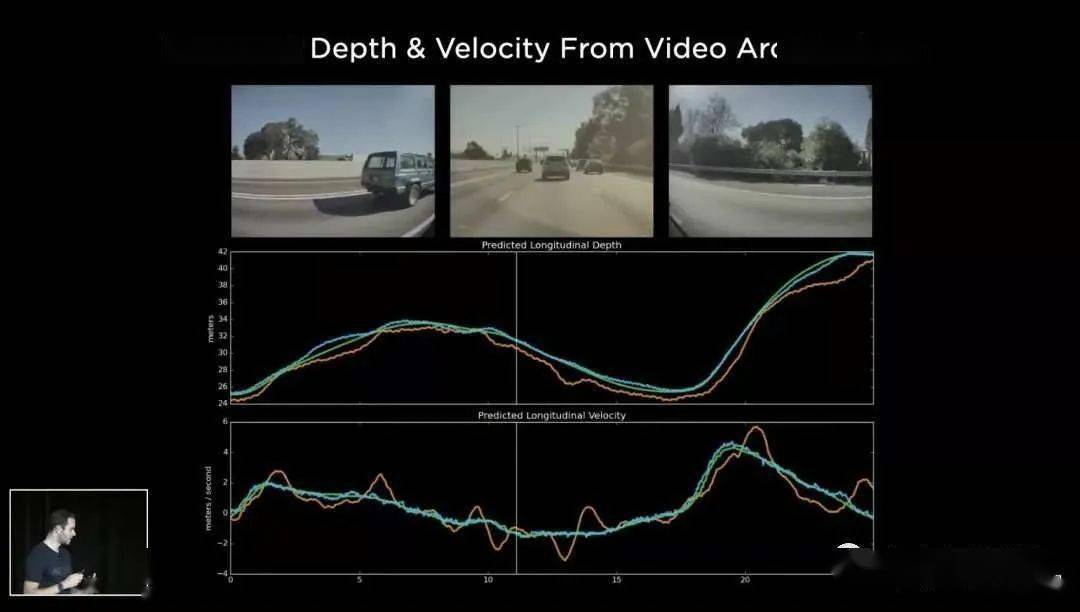

以上措施一起作用,效果很可观,多摄像头视觉方案已能替代毫米波雷达。景深与速度探测,是视觉感知最不擅长的领域之一,前几个月过了超越毫米波雷达的拐点;下图中绿线是毫米波雷达感知数据;黄线是单摄像头视觉感知数据,比较一般;蓝线是多摄像头视觉感知数据,与毫米波雷达基本一致,提升效果明显。

特斯拉抛弃毫米波雷达另一个底气是,改变传统以单张图片作为场景感知的最小单元,进化到通过连续视频图像对场景进行感知。通过视频图像对场景进行感知有多个好处,统一信息输入方式,避免因雷达、摄像头等不同感知元件提供相互独立的数据,避免造成算法复杂度增加;特斯拉可通过视频方式,掌握交通参与者当前运动方向及速度,不需借助雷达;特斯拉能通过视频构建车辆四周3D场景,有道路环境立体信息,让车辆更准确识别环境中危险元素。

以上是特斯拉FSD关于视觉感知与预测的重要内容,特斯拉AI总监Andrej Karpathy表示,这一些内容仍有改进空间。例如,在延迟方面,特斯拉团队还在探索预融合感知策略,及降低处理数据成本等。

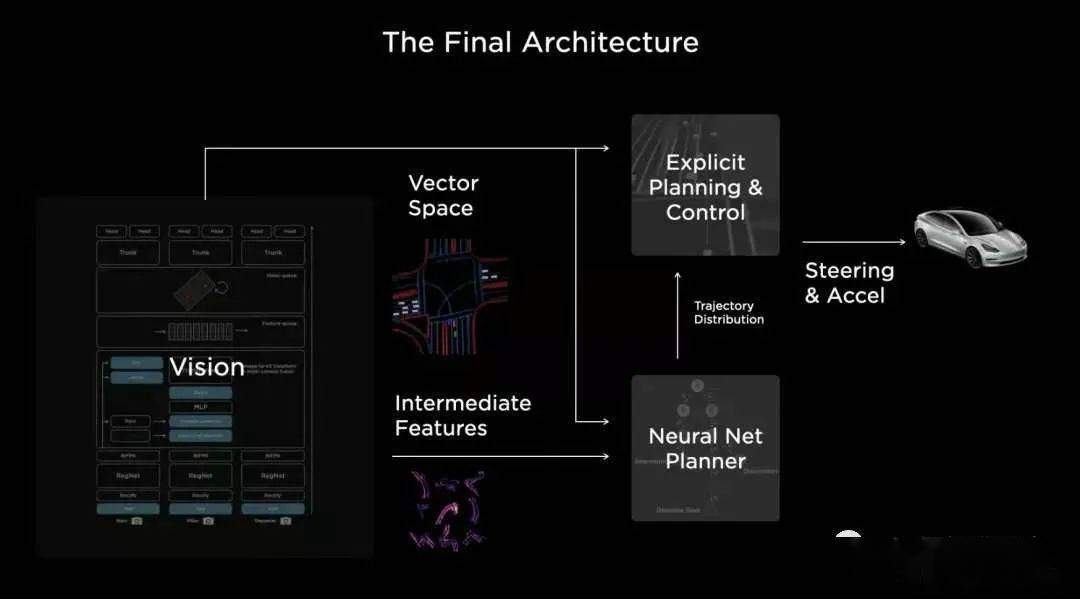

感知之后下一步,是做好规划控制。纯视觉感知系统完成特征识别,负责输入数据,形成矢量空间,然后统一输出给神经网络,再进一步通过轨迹分布模型,输出给规划控制管理系统,最终向车辆输出转向、加速等指令。

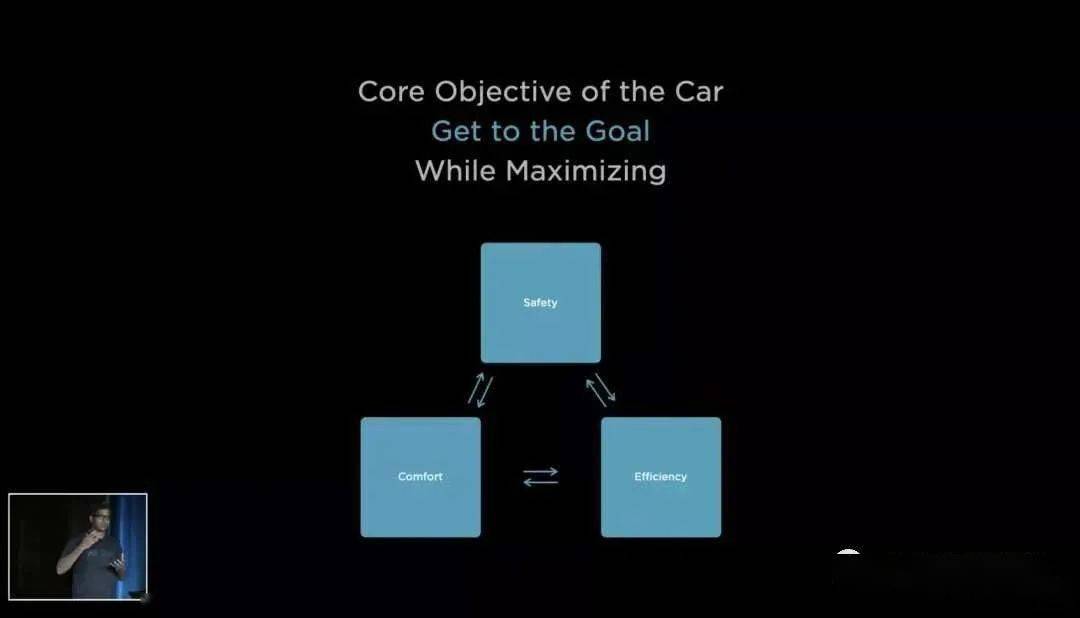

特斯拉Autopilot软件总监Ashok Elluswamy上台,介绍无人驾驶规划控制技术,规划控制核心目标是实现安全、舒适、效率三者最佳平衡。

特斯拉Autopilot软件总监Ashok Elluswamy认为,无人驾驶规划控制面临非凸面(Non-Convex)、高维(High-Dimensional)两大挑战。简单说,车辆行驶时,行为与路径不是唯一最优解,而有多个不同解法,且高度动态变化。

汽车换道为例,通常有两种路径,一种是尝试提早且缓慢换道,但不太舒适;另一种是较晚且迅速换道,但存在错失换道机会的风险;最优方案是在换道时,保持舒适与安全的平衡,车辆进行规划时,既考虑车辆自身,还要考虑到其他交通参与者。

特斯拉采用混合决策系统,首先让感知数据通过向量空间的粗搜索,然后经过连续优化,最后形成平滑的运动轨迹。

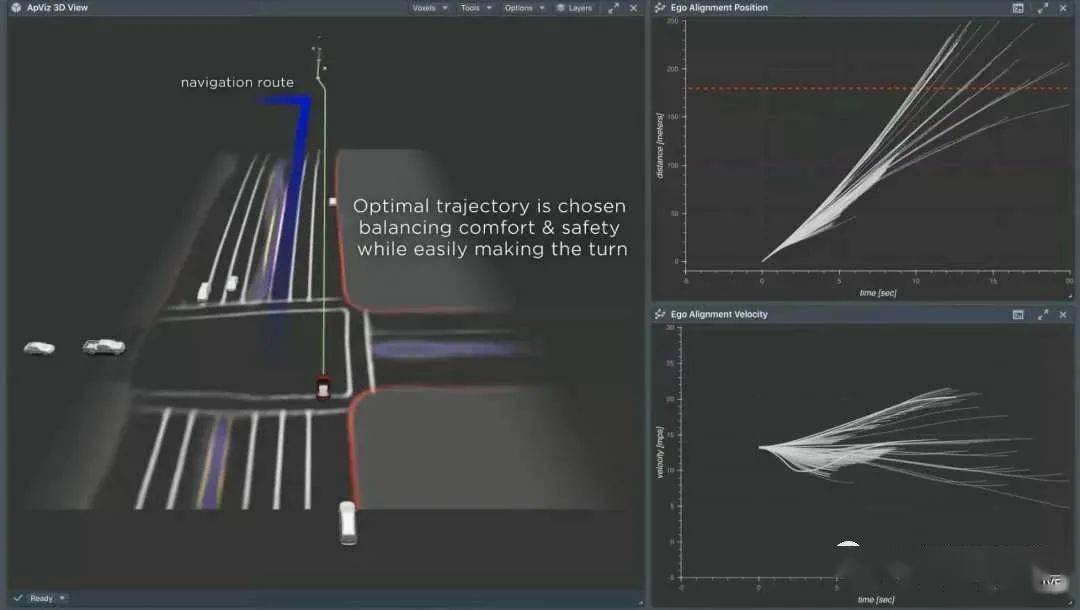

以下图场景为例,车辆需在路口后,向左并两次线到蓝线车道,之后完成左转;于是面临考虑包括,左侧车道后方有两台车快速接近;下个路口前,要在短距离内完成两次并线。

特斯拉汽车判断可向左变道,但考虑到左侧行驶的其他车辆,此时如果突然变道,车内乘客感受不佳,也会威胁交通安全。特斯拉汽车会在1.5毫秒内进行2,500次变道时机搜索,最终选择一条最安全、最舒适的变道措施。

实际行驶中,除了规划自身行驶路径,还需要预测其他交通参与者路径。在可行策略中,按安全、效率、舒适达到最佳平衡原则,进行路径优化。规划做好后,剩下事情是控制车辆按规划方案行驶。

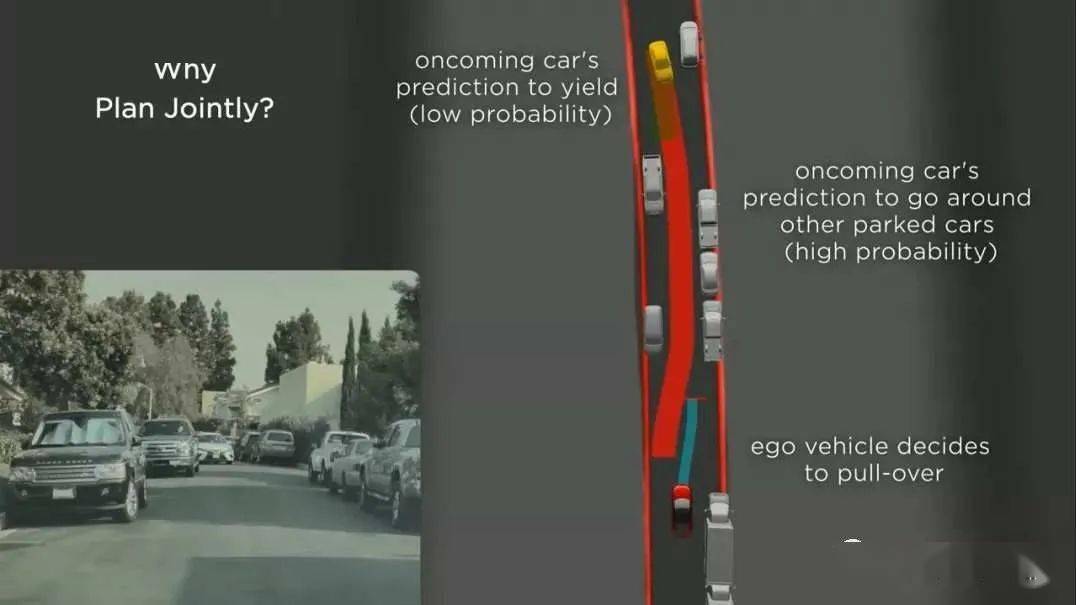

另一个案例中,特斯拉汽车行驶到一个超窄路段,没有车道线,道路两旁停着各种各样的车辆,两辆车无法同时通行。第一辆对向来车是一辆SUV,车主主动让行,特斯拉汽车判断继续前行。前行一段距离后,发现另一辆对向来车是一辆白色轿车,此时特斯拉汽车选择停车避让,这一举动像人类驾驶员要为对向车让路;但对向车辆同样选择停车避让,特斯拉汽车果断改变驾驶决策,再次启动,通过这一路段。

特斯拉Autopilot软件总监Ashok Elluswamy,向大家揭开视频背后特斯拉FSD如何思考。最初遇到对向来车时,那辆白色轿车被预测为要绕过其他车辆继续前进的可能性是大概率事件,停车避让是小概率事件,因此特斯拉选择靠边停车避让。真实的情况是,对向来车选择小概率事件,停车避让,特斯拉识别并理解这一行为,果断选择继续前进。

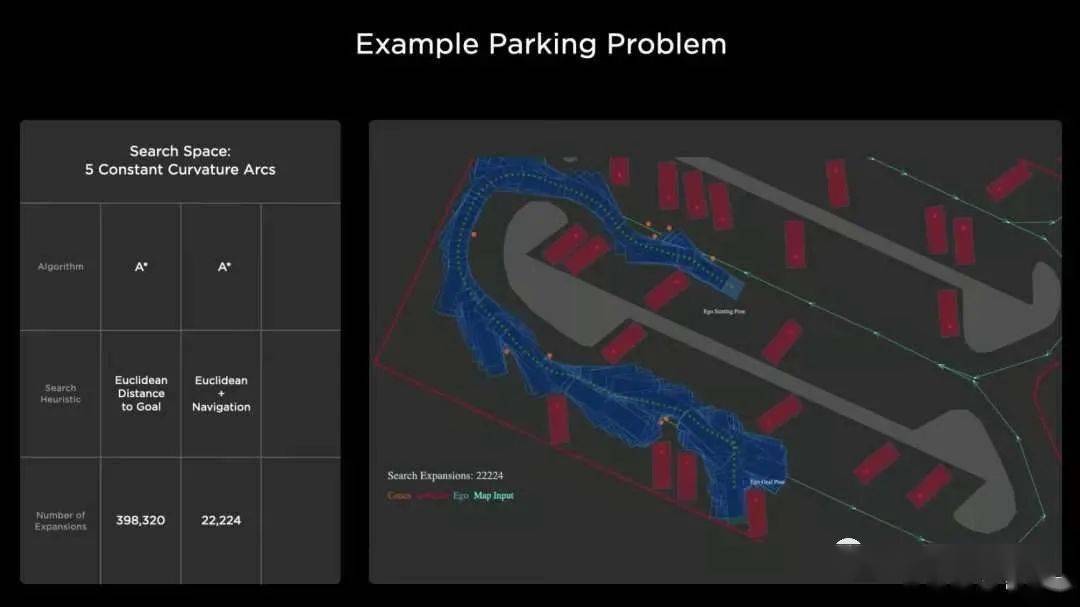

在更开放、无序道路场景下,规划控制复杂性提高很多。例如,在下图的停车场场景,如果设定的路径搜寻逻辑为欧几里德距离算法,FSD系统需尝试39.8万次计算,才能成功算出进入车位的路径。如果做一些优化,在搜寻逻辑中加入一条“遵循停车场的地标指引方向”,那么系统尝试2.2万次计算后,就能找到进入车位的路径,相比第一种策略,试错次数减少94.4%。

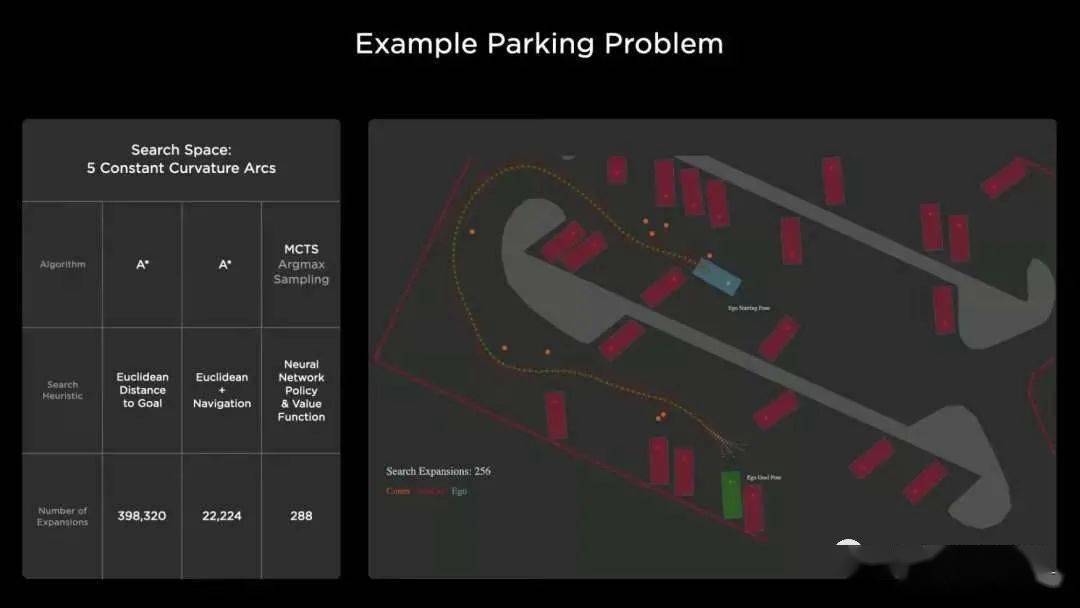

接下来再深入一些,算法改为蒙特卡洛树搜索,逻辑改为神经元网络策略与价值方程,系统仅需尝试28次计算,就能找到进入车位的路径,相比已经优化过的第二种方案,试错次数再减少98.7%。

从这个案例能够准确的看出,不同场景下,规划控制管理系统采用的逻辑与算法,对最终计算量有非常大影响,正确的方法能事半功倍。

感知与规划控制,是实现无人驾驶的两大关键能力,技术框架图如下。有了这个技术框架,还需把框架中神经网络训练到更高能力,就像人类有眼睛做感知、大脑+手脚做规划控制后,还需学习驾驶技能、积累驾驶经验,让机器学习开车也需“AI驾校”。

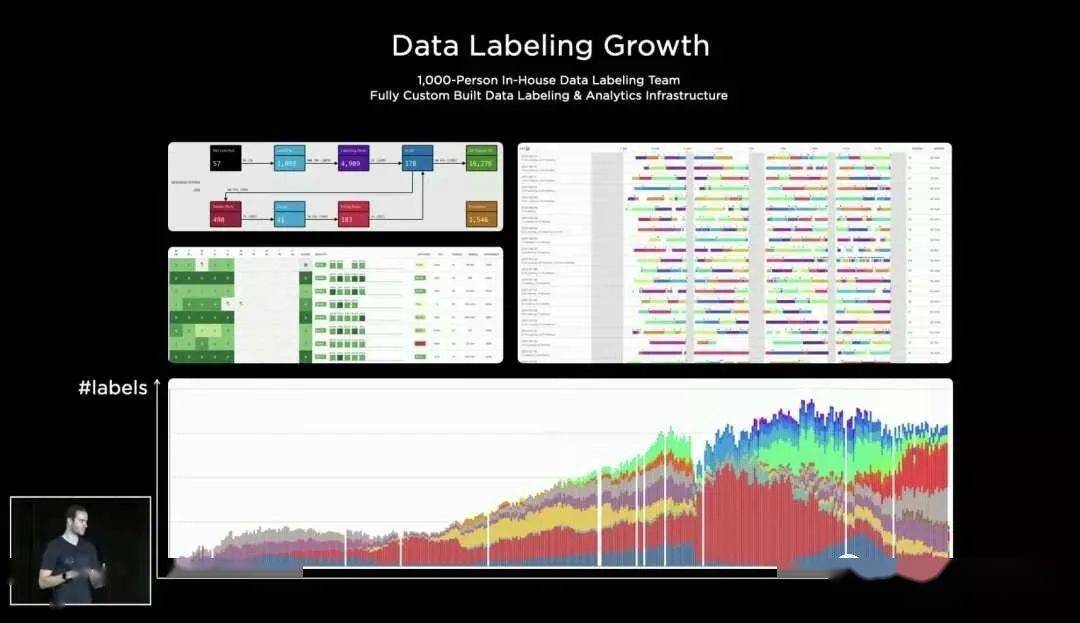

数据在让无人驾驶系统学习前需进行标记,是模拟训练的基础。无人驾驶车辆上路,将源源不断生成大量数据,随着特斯拉汽车销量增长,需为更多物体标记标签。

如何标记、分析、处理这一些数据,对算法进行训练?特斯拉是这样的领域处理数据顶级规模的公司。目前特斯拉设立人工数据标注、自动数据标注、仿真、数据规模化四个团队。

4年前,特斯拉与业内大部分公司一样,采用外包第三方标注团队,后来发现,这样做“延迟”太高,因此自建一支1,000人团队,从事数据标记工作。

随着时间推移,特斯拉标记的数据与日俱增,标记类型从在2D图像上标记,进化到在带时间坐标的4D空间上标记。

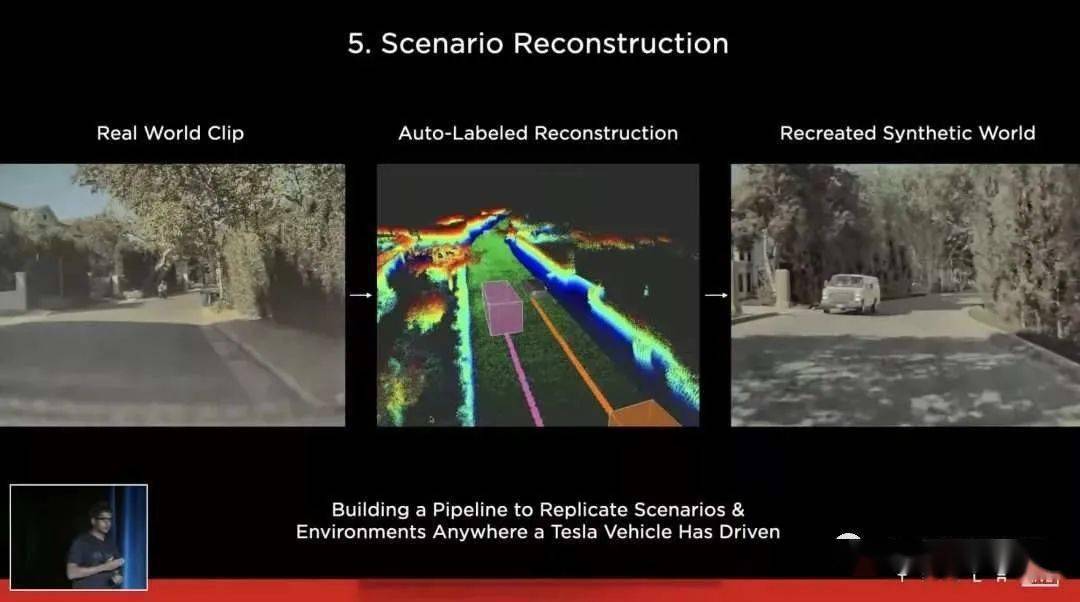

随着数据量剧增,特斯拉引入自动标注,自动标记成为数据标记重点。例如,输入行驶素材后,系统可自动标记车道线、路面、人行道等。

特斯拉采用多摄像头融合感知策略,自动标注工具可在一次标注下,实现所有摄像头多视角、多帧画面同步标注。甚至在做一次标签后,一个摄像头内的标签化图像,就能迁移到其他摄像头。

2021年6月举办的CVPR 2021(2021年国际计算机视觉与模式识别会议,国际电气与电子工程师协会主办的世界顶级计算机视觉会议之一)上,特斯拉AI总监Andrej Karpathy表示,特斯拉已拥有100万个约10秒左右视频数据,标注视频中60亿个物体距离、速度、加速度等信息,数据总量达1.5PB。

特斯拉汽车能在感知过程中重建道路,经过同一区域的特斯拉汽车够多时,就能将这片特定区域的道路都标记下来,收集同一路段的数据,实现更精确的重新建图。

这些数据并非用作高精地图,也不会一直保存在车辆系统上,只用作训练,为确保构建道路模型的质量,还需人工去剔除、优化一些数据。

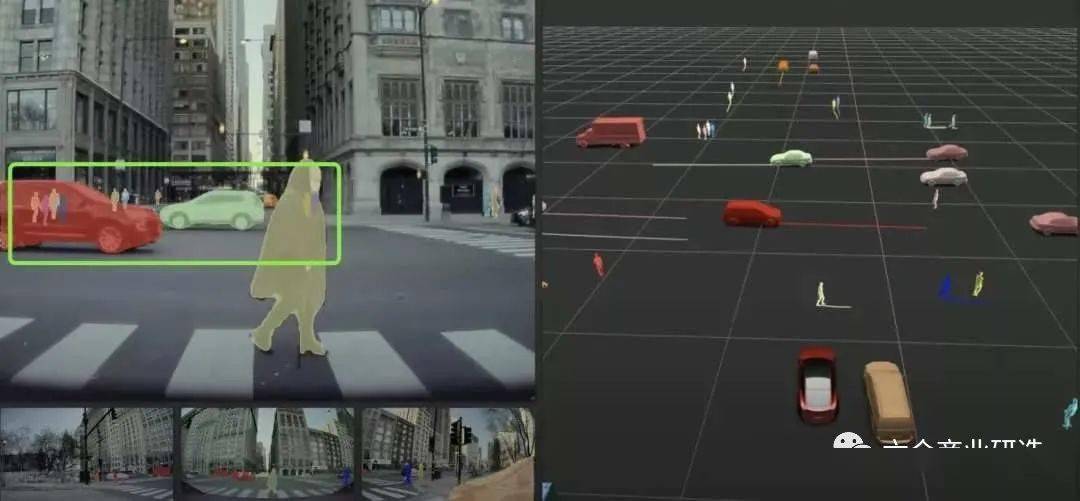

标记的特征也不限于常见的车道线等,围墙、路障等都可被标记。对规划控制算法中遮挡预测很有用的是遮挡透视标记。下图中绿圈实际被遮挡的物体会以透视方式标记出来,系统会知道在被遮挡时物体如何移动,进而有相应学习策略。

利用这些标记措施,特斯拉能构建非常逼真的环境模型,进行具体、有明确的目的性的算法训练。

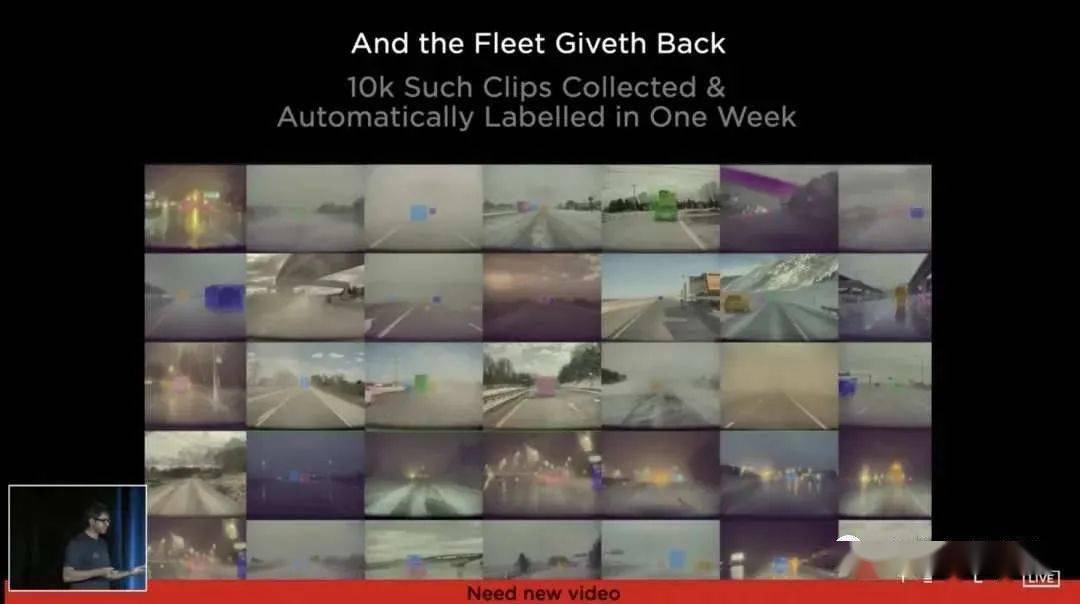

特斯拉将在美国销售的Model 3/Y车型取消毫米波雷达后,在雨、雾、雪等能见度较低天气下,摄像头能看清楚吗?答案是能。

针对特定场景,可从车辆标记好的数据中搜索类似场景,对神经网络进行快速泛化训练。例如,前方车辆被烟雾或其他干扰物遮挡的案例,特斯拉每周能获得1万段类似恶劣环境短片,通过自动标签实现精准感知,利用这些同类考题进行反复训练。

除了做真实驾驶测试外,还做模拟驾驶测试。2019年马斯克在无人驾驶日上表示,除了通过收集真实的道路环境数据来训练算法外,特斯拉还做大量模拟测试,特斯拉打造的模拟器可能是全球最强模拟器之一。

特斯拉进行Autopilot仿真测试,称为带有Autopilot的游戏。仿真测试中,电脑能精确标注、部署虚拟车辆,仿真测试用于模拟在生活中难以发现的情况。例如,高速道路上有人行走怎么办?一群人过没有交通灯的马路,无法同时标记怎么办?行驶到某段道路的尽头怎么办?这些场景主要是有不正常行为、特征标记不过来、很少去的地方等,这时利用可自定义的模拟器,对数据量起到有效补充。

仿真测试中,因模拟器自定义程度高,特斯拉工程师可设置不一样环境参数(障碍物、碰撞、舒适度等),测试极为特殊情况,提升训练效率。例如,人为制造挑战,设定噪点、曝光、反射率、热气流折射、动态模糊、光学畸变等,验证系统抗干扰性。

仿真测试有多项必要准备工作:1、传感器模拟要与线、要线、要有基本真实场景,包括车辆、行人,为模拟更多场景,目前这套模拟器已做上千种车辆、行人、其他道具模型,模拟器中道路总长超过2,000英里,相当于美国西海岸到东海岸长度;4、要有可扩展的场景,包括白天、黑夜等不同场景;5、能通过真实场景重构,在仿真测试中训练算法。

3.71亿张,还有4.8亿个标签。接下来,除了人、车等动态物体,特斯拉还将检测静态物体、道路、更多车辆、行人等,让纯视觉感知更精准。

AI驾校”里,特斯拉通过路上车辆,源源不断收集各类真实素材,这些素材经过标记、模拟重建后,设计更多仿真模拟场景,同时开发人员还可针对特定场景,设计模拟测试。特斯拉

FSD系统在这些仿真模拟场景中不断训练、提升经验,真实无人驾驶能力随之提高,最后能在准确识别物体后,实现在城市道路高等级自动驾驶。

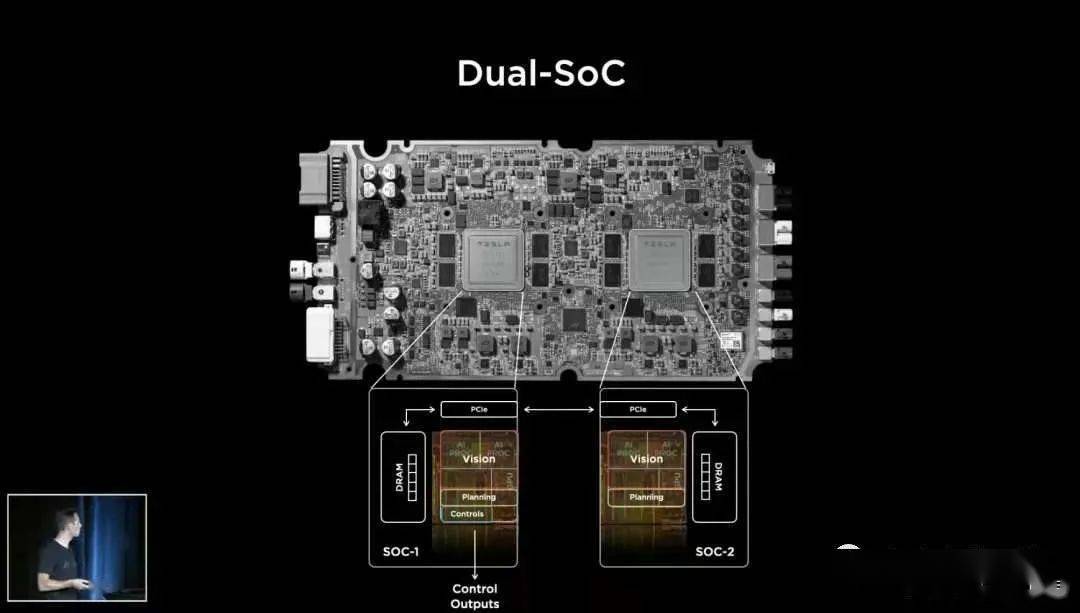

FSD芯片是HW 3.0(自动驾驶硬件系统3.0),2019年诞生,核心计算单元是双72 TOPS算力SoC芯片,采取了专用神经网络加速计算的架构。

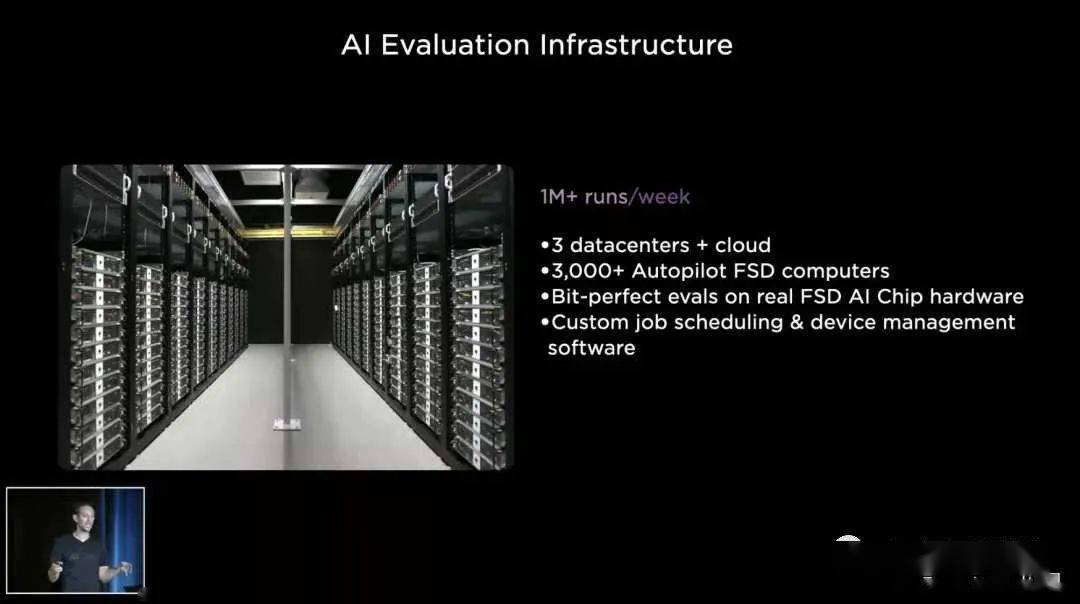

验证测试方面,特斯拉准备超过3,000个FSD芯片、专门设备管理软件、定制化测试计划,每周运行超过100万次算法验证测试。

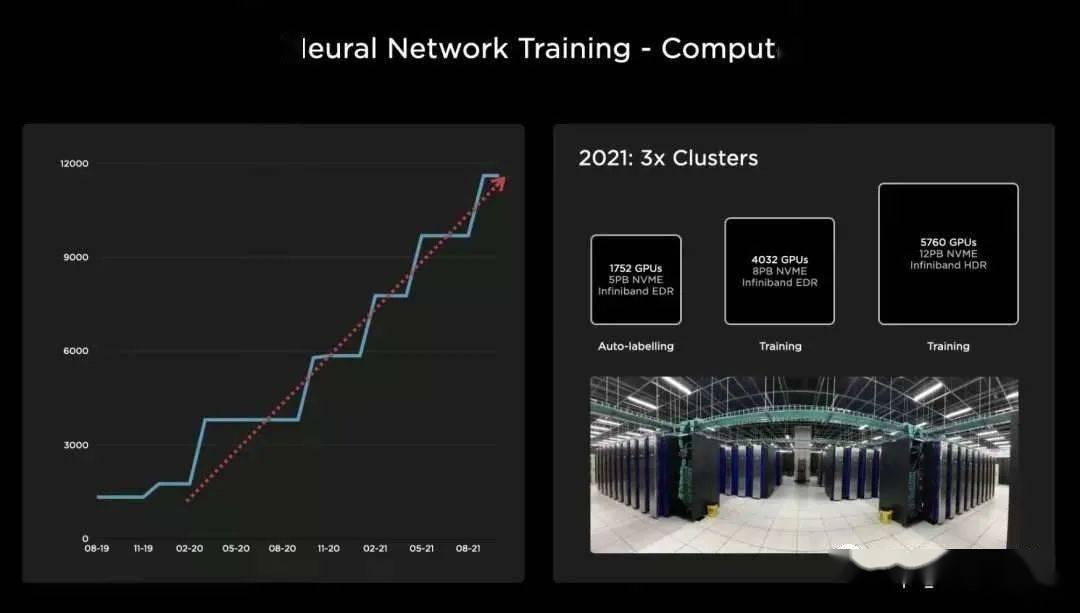

3大计算中心,自动标记计算中心有1,752个GPU,其他两个用来训练的计算中心分别有4,032个、5,760个GPU。

AI总监Andrej Karpathy强调,特斯拉算力过去2年实现翻倍增长。

Dojo,肩负训练AI算法的重任,是此次AI日发布会上最重磅产品。Dojo一词源自日语,意思是道场,特斯拉将自主研发的超级计算机命名Dojo,正是特斯拉FSD系统修行之地。

技术已是实现无人驾驶的关键,传感器感知环节完成后,规划控制、模拟训练等流程都需AI技术加持。不管是研发技术,还是战略规划上,特斯拉无人驾驶处领头羊,特斯拉打造自己超级计算机,训练AI模型将不断提速,通过更多场景、案例,实现更安全、更智能的无人驾驶,将逐步扩大一马当先的优势。特斯拉

Autopilot硬件总监、Dojo项目负责人Ganesh Venkataramanan上台,介绍神经网络训练超级计算机Dojo。Ganesh Venkataramanan表示马斯克几年前曾要求特斯拉工程师设计一台超高速训练计算机,这是特斯拉启动Dojo项目的原因。马斯克在2019年特斯拉无人驾驶日上,首次公布Dojo研发计划,此后不断为Dojo招募人才。

研发目标包括三个方面,分别是打造最强的AI训练性能,带动更大、更多的神经网络模式,实现高性能与低成本。Dojo将于2022年底开始运营,基于大量视频训练无人驾驶算法。

芯片解决车端算力需求,神经网络训练超级计算机Dojo解决云端算力需求。Dojo是利用互联网结构连接的分布式计算体系,拥有大型计算平面、超高带宽、低延迟、大型网络分区与映射等,基于新编译器优化局部通信与全局通信,可扩展性强。

从芯片开始自研Dojo并非简单的事,芯片产业链包括设计、制造、封测三大环节,解决能效与冷却等问题,每个领域均充满挑战。

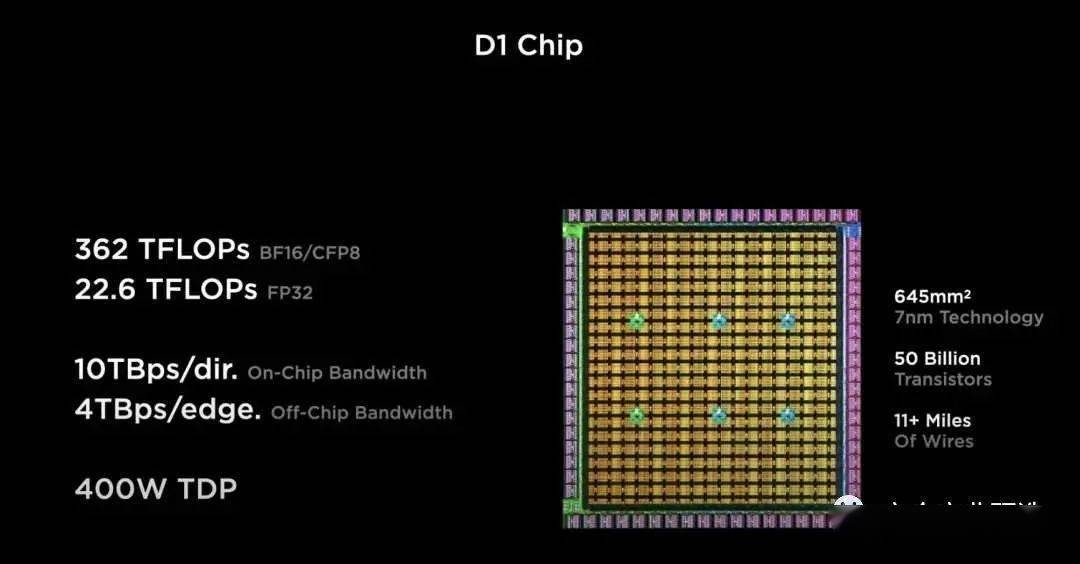

基于特斯拉自研AI训练芯片D1构建。D1芯片设计思路中很重要的一点是“专芯专用”,排布方式、带宽容量、节点架构等都围绕实现最佳神经网络训练能力而设计。D1

芯片采用分布式架构,7nm工艺制造,单颗芯片面积645mm²,包含500亿个晶体管,354个训练节点,峰值算力达362TFLOPS(BF16/CFP8精度下,BF16、CFP8为浮点计算格式标准),热设计功耗TDP不超过400W。

D1芯片采用InFO_SoW(晶圆上系统)技术,将所有芯片在同一个晶圆上进行设计,将整个晶圆做成一个超大芯片。这样做的好处是,芯片与芯片间物理距离极短,通讯结构可直接在晶圆上布置,使所有内核都能使用统一的2D网状结构互连,实现芯片间通信超低延迟与高带宽;基于结构优势,实现较低PDN阻抗,实现性能提升;整个芯片由多个小芯片阵列组成,可通过冗余设计避免良品率问题,实现芯片处理灵活性。

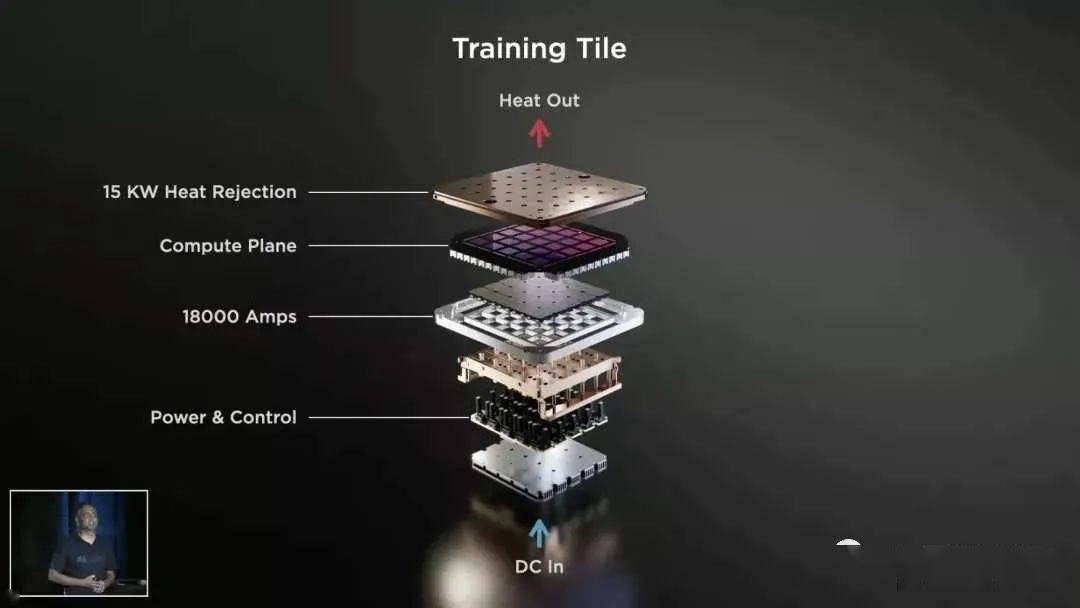

芯片具有GPU级别训练能力与CPU级别可控性。特斯拉将25个D1芯片组成1个训练模块Training Tile,一个训练模块接口带宽36TB/秒,峰值算力达9PFLOPS(BF16/CFP8精度下,BF16、CFP8为浮点计算格式标准),采用集中供电与散热设计,散热功率达15kW。1

个训练模块分为七层结构,第一层铜质结构是水冷散热模块;第二层由5*5阵列共25个芯片组成;第三层为25个阵列核心的BGA封装基板;第四层是物理承载结构,附带导热属性;第五层铜质结构是水冷散热模块;第六层是功率模块,及穿过散热模块与芯片进行高速通信的互联模块;第七层是物理承载结构,附带导热属性。

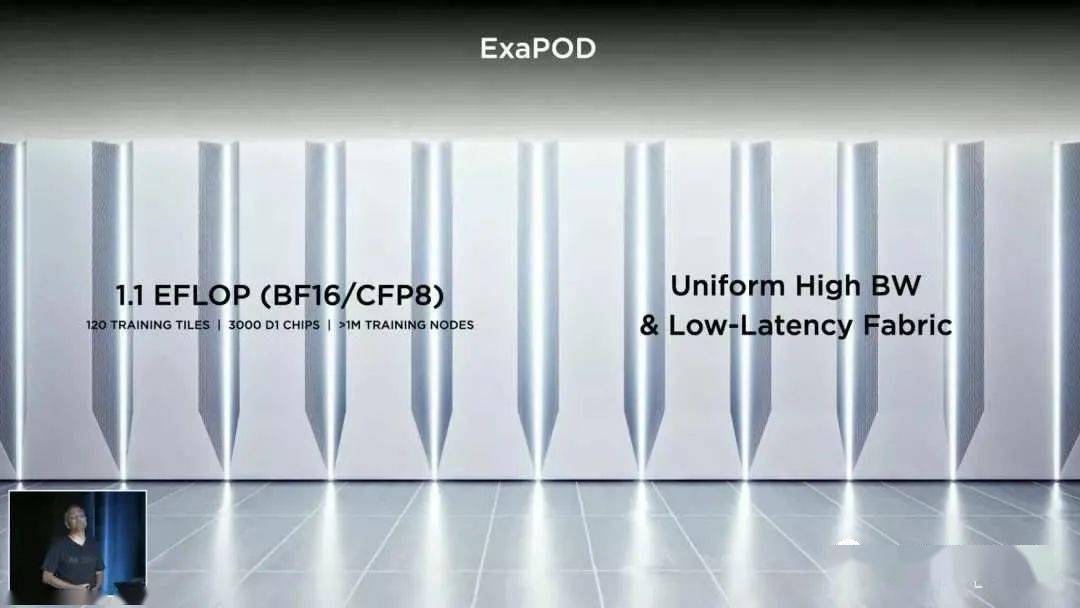

60个训练模块组成1台Dojo超级计算机,拥有1,500个D1芯片、53万多个训练节点。理论上,Dojo性能拓展没有上限,可无限扩张。实际应用中,特斯拉将

120个训练模块组成1个超级计算机系统ExaPOD,拥有3,000颗D1芯片、超过100万个训练节点,峰值算力达1.1EFLOPS(BF16/CFP8精度下,BF16、CFP8为浮点计算格式标准)。

分布式系统是分区块的,处理单元DPU(Dojo Processing Unit)是可根据应用需求调整大小的虚拟设备,包含多个D1芯片与接口处理器。特斯拉编译器引擎,可自动将执行指令映射到DPU上,无需人工操作。特斯拉还围绕这套计算系统构建完整软件堆栈,深度学习框架采用PyTorch。

项目负责人Ganesh Venkataramanan表示,Dojo是史上最快AI训练计算机,同等功耗下,Dojo超级计算机比现有计算机性能提升4倍、能效提升1.3倍、碳足迹只有原来1/5。D1芯片I/O带宽是目前行业最顶级网络芯片2倍水平,在浮点计算性能与片外带宽(Off-chip Bandwidth)上,大幅领先谷歌TPU芯片、其他顶级科技公司用GPU打造的分布式计算阵列。

预告,下一代Dojo超级计算机性能将再提升10倍,没有透露具体实现日期。

AI计算公司,在造出自己的超级计算机前,曾用英伟达GPU组装算力排世界第5的超级计算机。这个超级计算机使用720个节点,每个节点8个英伟达A100 Tensor Core GPU,共5,760个GPU,实现1.8EFLOPS算力性能。可见,特斯拉无论是Dojo,还是此前用英伟达GPU组装的超级计算机,都能跻身AI计算领域头部。

芯片应用不会止步于Dojo超级计算机,特斯拉还基于D1芯片进军机器人赛道。

COS机器人装束舞蹈后,马斯克上台,介绍Bot机器人,Bot是极具科幻色彩的拟人机器人,是这次AI日的彩蛋。马斯克强调这一设想总有一天能成真,欢迎更多行业人士加盟开发。特斯拉

AI日后不久,2021年8月24日,特斯拉在官网招聘页面上发布Bot机器人项目招聘信息。

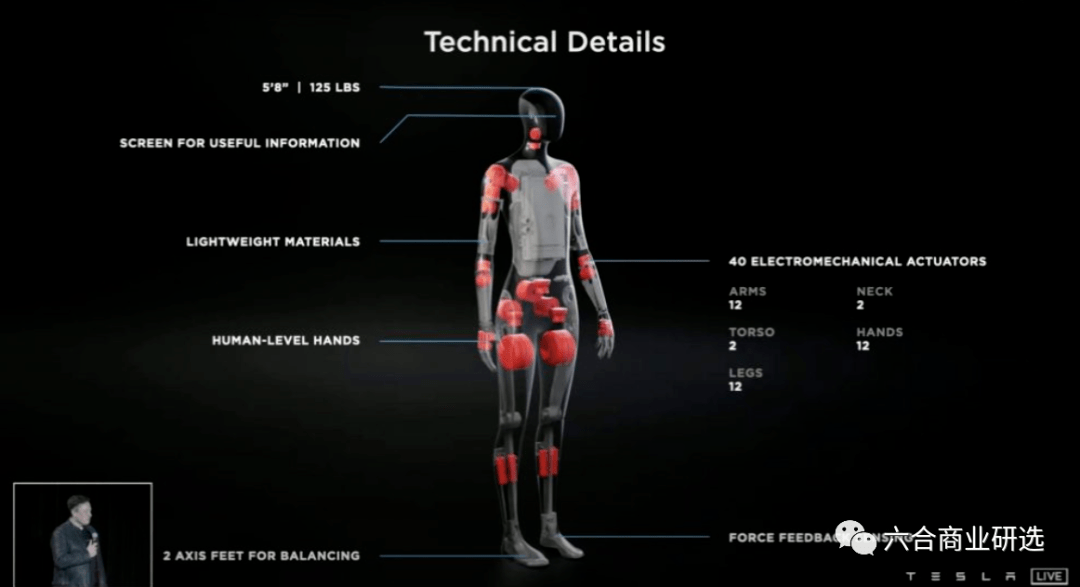

Bot机器人外形与人非常接近,还拥有人类级的四肢与工作上的能力。Bot机器人四肢使用40个机电执行器做相关操作,通过力反馈感应系统实现平稳与敏捷双脚行走,最快走路的速度5英里/小时(8公里/小时)。Bot机器人的手,与人手类似,有5根可灵活弯折的手指,有潜力代替人类执行一些精确操作任务。Bot机器人将通过力反馈感应实现平衡,脸会作为显示用户个人信息的屏幕。

Bot机器人将有5英尺8英寸高(约1.73米),体重125磅(约56.7千克),可抱起45磅重(约20.4千克)货物,也可通过举重硬拉姿势举起150磅(约68.0千克)重物。

Autopilot摄像头作为Bot机器人视觉感知系统,采用FSD芯片作为Bot机器人计算核心;计划以训练无人驾驶系统方式训练机器人AI能力,让Bot机器人成为多面手。

机器人与特斯拉汽车共用视觉系统与神经网络计算芯片,在基于神经网络的规划控制、自动标记、算法训练等技术上,Bot机器人有很多能用特斯拉汽车上已经很成熟的技术。虽然Bot机器人一台还没造,但可能已具备全世界智能机器人里最强的规模化优势。

Bot机器人初衷,希望能代替人类完成枯燥、危险、重复性强的工作,希望今后人类不想干的事统统交给机器人干。人的创意是无限的,马斯克推测人们可能会发掘出连他都预料不到的用途。

Bot机器人功能性,特斯拉还需用神经网络训练超级计算机Dojo对Bot机器人进行严格训练,预计2022年推出Bot机器人原型机。

Dojo与Bot机器人看,特斯拉视觉感知方案能做的事情,远比普通大众认为的要多得多,规模效应思路也开始有所体现。神经网络训练超级计算机Dojo与Bot机器人都是通过规模相应降低边际成本的做法,两者规模效应还能相辅相成。

:开发技术成本极高,即使开源也会收费,目前没有明确计划。如果其他车企想要使用我们的技术,可以商谈,这些技术不是只限特斯拉自己使用。Dojo本质上是一个ASIC属性的计算设备,也可被看作是通用型神经网络训练设备,未来不排除Dojo可提供给其他机构使用。

:我们一直在优化这个模拟软件,我们最终希望它能成为多功能通用模拟软件,关于怎么把这个软件拓展到特斯拉汽车以外的用户,我们目前只有一些粗略想法。

:无人驾驶主要需要视觉系统,可能也有一些声音处理需求,在实现完全自动驾驶前,我们会考虑所有需要做的事情。

:实际上我们在50多个国家获取数据,只是因我们在美国,所以美国数据多一些。不过主要的无人驾驶技术,在各国通用,如车辆要能识别车道及道路边界,这些在靠左行、靠右行的国家,都没差别。

:不是完全自动化,大部分能做到自动化生产,有些步骤目前离不开人工制造。

:因为芯片工作所需能源比较低,所以供电问题不大,主体问题是散热,但我们应用模组化设计,芯片散热问题能有效通过散热模组解决,占地空间很小。

:Dojo被设计,不止是为了无人驾驶,还有别的很多可能性。我们设计Dojo,是想在神经网络领域测试是否能用专门的芯片设计,超过GPU、CPU这种通用芯片性能。

:模拟软件基本构成类似游戏,在此之上,我们还用光线追踪等技术。我们也在用现实世界的数据,融合到模拟软件中。

:我们预计可能会在2022年某个时候,推出Bot机器人原型机,它们首先会做人们最不喜欢做的工作。

:我们目前没有计划,现在只是去做基础的劳动工作,也许之后能加入更多东西。我们研发Bot机器人,目的是从事危险、重复、无聊的工作,我们正在招募工程师将AI技术用于汽车之外领域。

:今天发布的只是Bot机器人1.0,只要能拿起工具做简单活动就行,之后我们会考虑进一步精进。

:随着我们收集更多数据,我们车辆会慢慢的安全,现在已经比人类驾驶员强很多。

:目前的确存在这样的一种情况,但很少遇到。如果之后发现这样的一种情况比较普遍,我们会重新训练FSD系统,提升辨别能力。例如,有人穿着一件带有停车标记的T恤,向特斯拉车辆进行展示,现在无人驾驶系统会识别并停车;我们后续可能会通过训练系统,使它认识到这是T恤,不是真的信号标记。

:当我们看不见对方时,我们基本上会考虑各种情况,即使是很极端的情况,最后我们会确保即使最极端的情况下,也不会互相干扰。我们属于比较保守的,但有时太保守会导致不现实,所以我们会找到两者间最佳平衡。

:不会,我们一般会获取大量数据,接着进行深度学习,直到我们觉得完美才发布,之后就不会每时每刻进行机器学习。

:我们现在用的摄像头,还未达到目前摄像技术的极限,但已经比人类驾驶强很多。如果之后我们达到摄像技术瓶颈,会考虑研发更好的摄像头。六合年度报告全库会员,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买

“智能电动汽车专题第一季+头号玩家第一季”优惠组合+六合年度会员,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买

+六合年度会员”,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买“年度观察

2019系列报告合集+六合年度会员”,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买“ IPO 观察第一季+六合年度会员”,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买

“ IPO 观察第二季+六合年度会员”,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买

“ IPO 观察第三季+六合年度会员”,欢迎扫描识别下方图中二维码或点击文末“阅读原文”购买

【智能电动汽车专题预售】百年汽车产业加速变革,智能电动汽车时代大幕开启【头号玩家第一季预售】:科技巨头探索未来,头号玩家梯队式崛起

【首份付费报告+年度会员】直播电商14万字深度报告:万亿级GMV风口下,巨头混战与合纵连横

【重磅】科技体育系列报告合集上线,“科技+体育”深层次地融合,全方位变革体育运动

【万字长文】九宇资本赵宇杰:5G开启新周期,进入在线世界的大航海时代|GBAT 2019 大湾区5G峰会

【IPO观察】第一季:中芯国际、寒武纪、思摩尔、泡泡玛特、安克创新等11家深度研报合集

【IPO观察】第二季:理想、小鹏、贝壳、蚂蚁、Snowflake、Palantir等12家公司深度研报合集

【IPO观察】第三季:Coinbase、Roblox、快手、雾芯科技等12家公司深度研报合集

【珍藏版】六合宝典:300家明星公司全景扫描,历时3年,210万字超5,000页,重磅推荐九宇资本赵宇杰:对智能电动汽车产业的碎片化思考

【2021回乡见闻录】22位90后2万字,就地过年与返乡过年碰撞,展现真实、立体、变革的中国

【重磅】22位“90后”2万字回乡见闻录,讲述他们眼中的中国县城、乡镇、农村

【重磅】得到:抓住知识服务本质,信用构建增长飞轮,以肉眼可见速度持续进化【重磅】中国新经济龙头,赴港赴美上市报告合辑20篇

知识服务+付费+音频,开启内容生产新的产业级机遇,知识经济10年千亿级市场规模可期

九宇资本赵宇杰:科技改变消费,让生活更美好|2017 GNEC 新经济新消费峰会九宇资本赵宇杰:创业时代的时间法则,开发用户平行时间|2016 GNEC 新经济新智能峰会

平台声明:该文观点仅代表作者本人,搜狐号系信息发布平台,搜狐仅提供信息存储空间服务。

上一篇: Pad之家_平板电脑之家_数码IT